Synthetische data is informatie die kunstmatig wordt gegenereerd door computeralgoritmen in plaats van te worden verzameld uit gebeurtenissen in de echte wereld of van individuen. In 2026 voorspelt Gartner dat 75% van de bedrijven generatieve AI zal gebruiken om synthetische klantgegevens te produceren, een aanzienlijke stijging ten opzichte van minder dan 5% in 2023. Deze technologie werkt door generatieve modellen te trainen op originele datasets om hun statistische patronen, correlaties en structurele eigenschappen te leren, en vervolgens volledig nieuwe datapunten te creëren die de bruikbaarheid van het origineel behouden zonder persoonlijk identificeerbare informatie (PII) te bevatten.

De belangrijkste drijfveer voor de adoptie van synthetische data is de groeiende frictie tussen de behoefte aan grote datasets om AI-modellen te trainen en de toenemende strengheid van wereldwijde privacyregelgeving zoals de AVG (GDPR) en de EU AI Act. Organisaties gebruiken synthetische data om de beperkingen van traditionele data-maskering te omzeilen, ontwikkelcycli te versnellen en zeldzame “edge case”-scenario’s te simuleren die ondervertegenwoordigd zijn in echte omgevingen.

Wanneer synthetische data te gebruiken

De beslissing om synthetische data te implementeren in plaats van echte data hangt af van de specifieke vereisten van het project, inclusief privacybeperkingen, databeschikbaarheid en de noodzaak voor gecontroleerde experimenten.

Privacy en naleving van regelgeving

Synthetische data wordt ingezet wanneer strikte privacyregels het gebruik van productiedata voor testen of modeltraining verhinderen. In tegenstelling tot anonimisering of pseudonimisering, die vaak ongedaan gemaakt kunnen worden via linkage-aanvallen, heeft hoogwaardige synthetische data geen één-op-één-koppeling met echte individuen. Dit maakt het een essentieel instrument voor sectoren zoals de gezondheidszorg en de financiële wereld, waar het delen van gegevens sterk beperkt is.

Dataschaarste en edge case-simulatie

In veel Machine Learning-toepassingen is echte data ongebalanceerd. Bij fraude-detectie zijn legitieme transacties bijvoorbeeld vele malen talrijker dan frauduleuze. Synthetische data-generatie stelt engineers in staat om miljoenen samples voor deze zeldzame gebeurtenissen te creëren, waardoor het vermogen van het model om patronen te herkennen die het anders zelden zou zien, wordt verbeterd. Dit is ook cruciaal voor autonome systemen, zoals zelfrijdende voertuigen, waar het simuleren van gevaarlijke of zeldzame wegomstandigheden veiliger en kosteneffectiever is dan testen in de echte wereld.

Rapid prototyping en intern delen

Aanvragen voor datatoegang binnen grote ondernemingen kunnen weken of maanden duren vanwege beveiligingsgoedkeuringen. Synthetische datasets kunnen vrij tussen afdelingen worden gedeeld zonder hetzelfde niveau van administratieve overhead. Dit stelt teams in staat om direct te beginnen met het bouwen van applicaties terwijl ze wachten op formele toegang tot productiesystemen.

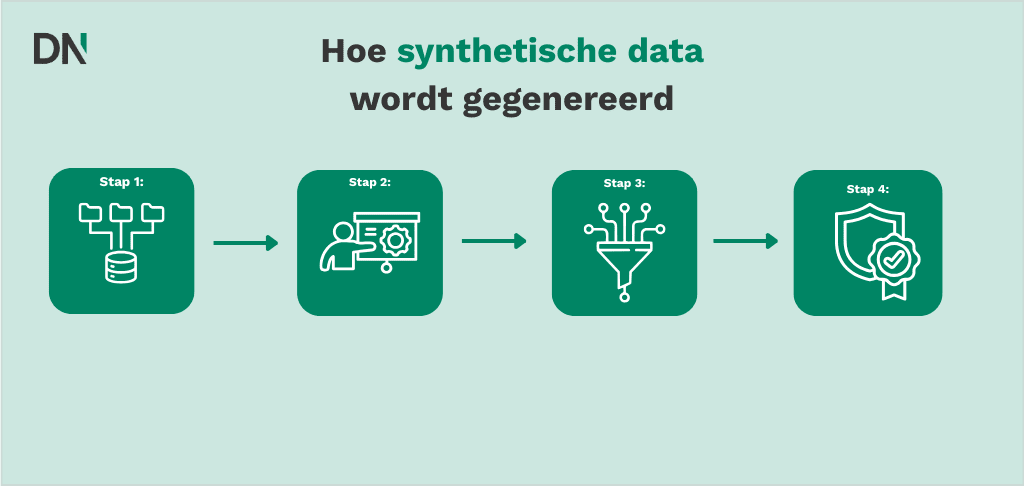

Hoe synthetische data wordt gegenereerd

Het technische proces van het genereren van synthetische data omvat verschillende fasen, variërend van initiële data-analyse tot de uiteindelijke validatie van de bruikbaarheid.

Stap 1: Data-ingestie en analyse Het proces begint met een “seed” dataset als input. Het generatie-algoritme analyseert de metadata, het schema en de statistische distributies van deze data. Dit omvat het identificeren van de typen variabelen (categorisch, numeriek of time-series) en de complexe relaties daartussen. In een retail-dataset moet het algoritme bijvoorbeeld leren dat “aankoopdatum” en “leveringsdatum” een logische temporele relatie hebben.

Stap 2: Het trainen van het generatieve model Afhankelijk van het datatype worden verschillende wiskundige benaderingen gebruikt:

- Generative Adversarial Networks (GANs): Deze bestaan uit twee neurale netwerken, een generator en een discriminator, die tegen elkaar strijden om steeds realistischere data te produceren.

- Variational Autoencoders (VAEs): Deze comprimeren de inputdata naar een representatie in een lagere dimensie en reconstrueren deze vervolgens, wat de generatie van nieuwe, vergelijkbare datapunten mogelijk maakt.

- Diffusion Models: Vaak gebruikt voor ongestructureerde data zoals afbeeldingen; deze modellen leren een proces van het toevoegen van ruis aan data om te keren.

Stap 3: Synthese en privacy-filtering Eenmaal getraind, genereert het model nieuwe data. Een kritieke substap is de toepassing van differential privacy of andere privacy-filters. Deze filters zorgen ervoor dat het model niet simpelweg specifieke rijen van de originele data heeft “onthouden” (overfitting), wat zou leiden tot een privacylek.

Stap 4: Quality Assurance en bruikbaarheidstests De uiteindelijke synthetische output wordt vergeleken met de originele data middels statistische metrieken. Dit geautomatiseerde QA-proces controleert de “utility” (bruikbaarheid) en garandeert dat een Machine Learning-model dat is getraind op de synthetische data vergelijkbaar zal presteren als een model dat is getraind op echte data.

Vergelijkende analyse van platforms voor synthetische data

De markt voor platforms voor synthetische data in 2026 wordt gecategoriseerd door het type data waarin ze gespecialiseerd zijn (gestructureerd vs. ongestructureerd) en hun integratiemogelijkheden.

| Platform | Specialisatie | Belangrijkste kenmerken | Doelgroep / Use Case |

|---|---|---|---|

| Gretel.ai | Multi-modal (tekst, tabulair, relationeel) | API’s voor developers, privacy-as-code, en ondersteuning voor complexe relationele databases. | DevOps, AI-training en datadeling. |

| Mostly.ai | Gestructureerde/tabulaire data | High-fidelity reproductie van gedrags- en time-series data. | Bankwezen, verzekeringen en telecommunicatie. |

| Tonic.ai | Database synthese | Subsetting, de-identificatie en synthese over meerdere onderling verbonden databases. | Softwaretesten en QA-omgevingen. |

| NVIDIA NeMo | Agentic AI & ongestructureerde data | Tekstgebaseerde synthetische data voor het trainen van LLM’s en autonome agents. | Robotica, conversatie-AI en onderzoek. |

| Synthesis AI | Computer Vision | Generatie van fotorealistische menselijke afbeeldingen en 3D-omgevingen. | Biometrie, beveiliging en virtual reality. |

Het kiezen van het juiste platform vereist vaak een Proof of Concept (PoC) om te bepalen welke tool de hoogste bruikbaarheid behoudt voor jouw specifieke datadistributies.

Beperkingen en technische overwegingen

Hoewel synthetische data aanzienlijke voordelen biedt, is het in niet alle scenario’s een directe vervanging voor echte data.

- Model Collapse: Als AI-modellen herhaaldelijk worden getraind op synthetische data zonder nieuwe input uit de echte wereld, kunnen ze de “staart” van de distributie verliezen, wat leidt tot een afname van diversiteit en nauwkeurigheid.

- Bias-versterking: Als de seed-data historische bias bevat (bijv. gender- of etnische bias bij werving), zal de synthetische generator deze bias waarschijnlijk reproduceren en mogelijk versterken. Zorgvuldige auditing is vereist.

- Complexe uitschieters: Zeldzame maar kritieke uitschieters in de echte wereld kunnen door het generatieve model als ruis worden weggefilterd, wat problematisch kan zijn in vakgebieden zoals medische diagnostiek waar de uitschieter juist het belangrijkste datapunt is.

Voor organisaties die door deze complexiteiten navigeren, kan een AI-implementatiepartner helpen bij het ontwerpen van hybride workflows die echte en synthetische data combineren om deze risico’s te beperken.

Conclusie

Synthetische data is in 2026 getransformeerd van een niche privacy-tool naar een fundamenteel onderdeel van de enterprise AI-stack. Door organisaties in staat te stellen privacy-bottlenecks te omzeilen, zeldzame scenario’s te simuleren en ontwikkeling te versnellen, biedt het een schaalbare oplossing voor het wereldwijde datatekort. Het succesvolle gebruik van synthetische data vereist echter een rigoureuze aanpak van utility-validatie en bias-management.Om te zien hoe deze technologieën kunnen worden toegepast op jouw specifieke zakelijke uitdagingen, kun je een demo boeken om implementatiestrategieën te verkennen die zijn afgestemd op jouw sector.

Veelgestelde vragen (FAQ)

Wordt synthetische data beschouwd als persoonsgegevens onder de AVG?

Over het algemeen niet. Als de synthetische data zodanig is gegenereerd dat deze geen betrekking heeft op een geïdentificeerde of identificeerbare natuurlijke persoon en niet kan worden herleid tot de oorspronkelijke betrokkenen, wordt het beschouwd als anonieme informatie en valt het buiten de reikwijdte van de AVG. Het proces van het genereren ervan omvat echter vaak het verwerken van echte persoonsgegevens, wat nog steeds aan de wettelijke vereisten moet voldoen.

Kan synthetische data worden gebruikt om Large Language Models (LLM’s) te trainen?

Ja. Synthetische data wordt steeds vaker gebruikt voor het fine-tunen van LLM’s, vooral voor domeinspecifieke taken waar echte conversatiedata schaars of gevoelig is. Dit is een kerncomponent van het bouwen van aangepaste AI-oplossingen voor bedrijfsomgevingen.

Hoe meet ik de kwaliteit van synthetische data?

Kwaliteit wordt doorgaans gemeten via twee invalshoeken: Utility en Privacy. Utility wordt gemeten door de statistische distributies van de synthetische en echte data te vergelijken, of door te controleren of een model dat getraind is op synthetische data een vergelijkbare nauwkeurigheid behaalt op een testset uit de echte wereld. Privacy wordt gemeten via re-identificatie risico-assessments.

Wat is het verschil tussen synthetische data en data-maskering?

Data-maskering (of de-identificatie) wijzigt bestaande records door specifieke velden te verwijderen of te verbergen. Synthetische data creëert echter volledig nieuwe records vanaf nul. Synthetische data biedt doorgaans een hogere privacybescherming en behoudt de statistische integriteit van complexe datasets beter dan traditionele maskering.