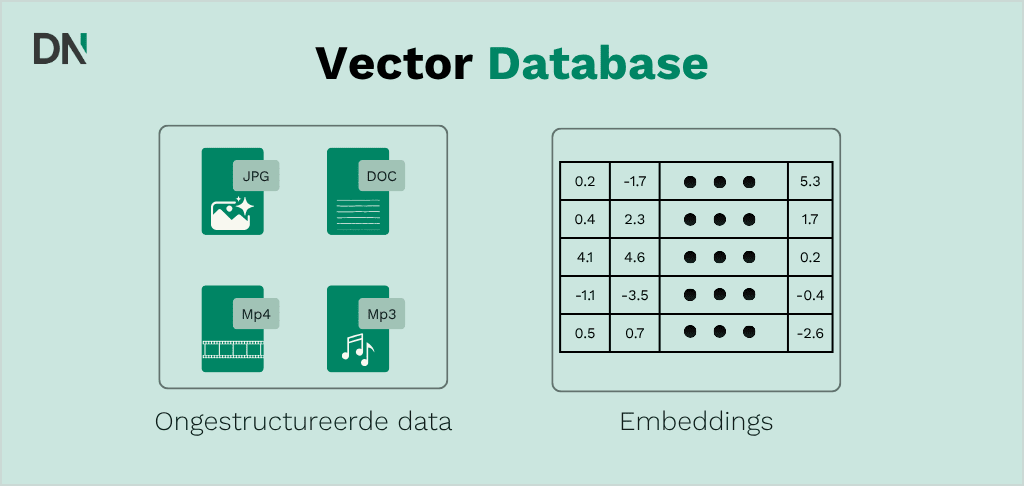

Een vector database is een gespecialiseerd opslagsysteem ontworpen voor het indexeren en ophalen van hoog dimensionale data, vaak aangeduid als vector embeddings. In 2026 dienen deze databases als de fundamentele geheugenlaag voor Large Language Models (LLM’s) en Retrieval-Augmented Generation (RAG) architecturen. Vector Databases zetten ongestructureerde data zoals tekst en beeld om in numerieke arrays voor geavanceerde analyses. Hierdoor zoeken bedrijven niet langer op trefwoorden, maar op basis van werkelijke context en intentie.

Het zakelijke landschap is verschoven van experimentele pilots naar deployment op productieniveau. Bij de keuze voor een vector database draait het nu om drie zaken: schaalbare architectuur, veilige multi-tenancy en de kracht van hybride zoekfuncties. Deze pijlers zorgen ervoor dat het systeem meegroeit met je bedrijf terwijl data strikt gescheiden en vindbaar blijft.

De rol van vector databases in de AI-stack

Vector databases werken door datapunten in kaart te brengen in een continue geometrische ruimte. Wanneer een query wordt gestart, berekent de database de wiskundige afstand tussen de query-vector en de opgeslagen vectoren om de meest relevante informatie te vinden. Dit proces is essentieel voor de ontwikkeling van een AI-strategie, omdat het organisaties in staat stelt hun eigen data te gebruiken binnen generatieve AI-workflows.

In de huidige zakelijke omgeving zijn vector databases geen op zichzelf staande tools meer. Ze zijn geïntegreerde componenten van een end-to-end data pipeline. Voor organisaties die een AI-implementatie overwegen, beïnvloedt de database keuze de zoek latentie, de operationele kosten en de nauwkeurigheid van door AI gegenereerde antwoorden.

Een opvallende trend in 2026 is consolidatie: veel organisaties heroverwegen of een dedicated vector database überhaupt nodig is. Voor de meeste RAG-use cases onder de circa 5 tot 50 miljoen vectoren presteert pgvector binnen een bestaande PostgreSQL-setup adequaat voor veel teams en elimineert het de noodzaak om een apart gespecialiseerd systeem te introduceren. Dit maakt pgvector een serieuze optie die het evalueren waard is voordat men zich vastlegt op een dedicated oplossing; dit wordt verderop in een eigen sectie behandeld.

Pinecone: De serverloze standaard voor beheerde schaling

Pinecone heeft zichzelf gepositioneerd als de primaire beheerde service voor ondernemingen die prioriteit geven aan operationele eenvoud. De serverless architectuur blijft de industriestandaard voor het ontkoppelen van opslag en rekenkracht (compute), waardoor gebruikers alleen betalen voor de data die ze opvragen.

Technische architectuur en prestaties

Pinecone Serverless maakt gebruik van een gelaagde opslag aanpak. Het slaat de primaire vector index op in goedkope object-opslag (zoals S3) en haalt alleen de noodzakelijke segmenten op naar een snelle cache tijdens een zoekopdracht. Dit resulteert in een vermindering van de overheadkosten tot wel 50 keer vergeleken met traditionele pod-gebaseerde architecturen (gebaseerd op schattingen van Pinecone zelf).

Belangrijke technische specificaties zijn onder meer:

- Indexing algorithm: Eigen graph-gebaseerde indexering geoptimaliseerd voor low-latency retrieval.

- Scalability: Ondersteunt miljarden vectoren zonder handmatige sharding.

- Metadata filtering: Maakt real-time filtering van resultaten mogelijk op basis van key-value pairs (bijv. datum, regio of afdeling).

- Hybrid search: Pinecone ondersteunt sparse-dense hybrid search via eigen sparse encoding. Dit verschilt van de standaard BM25-implementaties die door open-source alternatieven worden gebruikt, maar biedt waardevolle hybrid search functionaliteit voor de meeste zakelijke use cases.

- Pinecone Assistant: Bereikte algemene beschikbaarheid in januari 2025. Dit product combineert chunking, embedding, vector search, reranking en antwoord generatie achter één endpoint, waardoor Pinecone verschuift van pure vector opslag naar een completere beheerde RAG-oplossing.

Enterprise usecases en datasoevereiniteit

Organisaties kiezen vaak voor Pinecone wanneer ze een AI-oplossing op maat nodig hebben die snel moet schakelen zonder een dedicated DevOps-team. Het wordt veelvuldig gebruikt in wereldwijde klantenservice bots waar uptime en beheerde infrastructuur cruciaal zijn. Pinecone beschikt over SOC 2 Type II, ISO 27001, GDPR-afstemming en HIPAA-attest certificeringen, waardoor het een veel voorkomende keuze is in gereguleerde sectoren zoals de financiële sector en de gezondheidszorg.

Wat betreft data soevereiniteit: Pinecone’s BYOC (Bring Your Own Cloud) modus bereikte algemene beschikbaarheid in 2024, waardoor clusters kunnen draaien binnen het eigen AWS-, Azure- of GCP-account van een klant. Dit biedt strikte data-isolatie voor organisaties met strenge compliance-eisen en verandert de calculus voor on-premise oplossingen aanzienlijk vergeleken met eerdere jaren toen Pinecone alleen beschikbaar was als publieke cloud service.

Weaviate: De open-source leider in hybrid search

Weaviate is een open-source vector database die de nadruk legt op modulariteit en flexibiliteit van data. Het belangrijkste onderscheidende kenmerk in 2026 is de volwassen en functie rijke hybrid search stack, die traditionele keyword matching combineert met moderne vector embeddings.

Kernfuncties en modulariteit

Weaviate is gebouwd rond een “klasse”-systeem, vergelijkbaar met objectgeoriënteerd programmeren, wat het voor software engineers intuïtief maakt om te integreren. Het ondersteunt een breed scala aan embedding-modellen via ingebouwde modules.

Belangrijke prestatie drivers zijn:

- Hybrid search: Combineert vector resultaten met keyword-resultaten met behulp van Reciprocal Rank Fusion (RRF) en het geavanceerdere Relative Score Fusion (RSF), dat de nuances van de originele zoek scores behoudt in plaats van alleen de rangorde, wat mogelijk nauwkeurigere rankings oplevert. BlockMax WAND bereikte algemene beschikbaarheid in 2025, waardoor de component voor trefwoord zoeken ongeveer 10 keer sneller is dan in eerdere versies.

- Multi-vector ondersteuning: MUVERA-encoding verwerkt nu native documenten met meerdere vectoren, wat relevant is voor complexe documentstructuren.

- Knowledge graph mogelijkheden: Weaviate is de enige grote vector database die native vector search combineert met een knowledge graph-laag, wat toepassingen mogelijk maakt die gestructureerde relaties tussen entiteiten moeten weergeven en doorkruisen naast semantische gelijkenis.

- Multi-tenancy: Biedt robuuste isolatie voor verschillende gebruikers of klanten binnen een enkele cluster, een vereiste voor SaaS-providers.

- Deployment flexibiliteit: Kan on-premise worden geïmplementeerd, in een private cloud of via Weaviate Cloud Services (WCS).

Toepassing in gespecialiseerde sectoren

Weaviate wordt vaak geprezen om zijn vermogen om complexe schema’s te verwerken. Het open-source karakter maakt diepgaande aanpassing mogelijk, wat gunstig is voor sectoren met strikte eisen op het gebied van data soevereiniteit. Organisaties waarvan het kernpatroon van zoekopdrachten is: “vinden van semantisch vergelijkbare documenten die ook een specifieke term of wet noemen”, zullen de hybrid search implementatie van Weaviate in 2026 als de meest volwassen op de markt ervaren.

Qdrant: High-performance search voor resource-efficiënte systemen

Qdrant is geschreven in Rust, een programmeertaal die bekend staat om geheugen veiligheid en hoge prestaties. Qdrant is de voorkeurskeuze voor ondernemingen die een hoge doorvoer en een laag resource verbruik vereisen, met name in edge computing of omgevingen met hoogfrequente data.

Technische efficiëntie en quantisatie

Qdrant richt zich op scalar quantization, een proces dat 32-bit floating-point vectoren comprimeert naar 8-bit integers. Dit vermindert het geheugengebruik tot wel 4x met behoud van een zoek nauwkeurigheid van boven de 99%.

Gedetailleerde technische statistieken:

- Throughput: In staat om tienduizenden zoekopdrachten per seconde (QPS) te verwerken op standaard hardware.

- API-ondersteuning: Biedt native ondersteuning voor gRPC en REST-API’s, wat compatibiliteit met diverse tech stacks garandeert.

- HNSW-implementatie: Maakt gebruik van een sterk geoptimaliseerde versie van het Hierarchical Navigable Small World (HNSW) algoritme voor snelle approximate nearest neighbor search. Het ACORN-algoritme, geïntroduceerd in 2025, maakt gefilterde HNSW echt competitief bij nauwe filter ratio’s, wat de positie van Qdrant als de sterkste optie voor complexe metadata-filtering op schaal versterkt.

- Hybrid search: Sinds v1.9 ondersteunt Qdrant “named vectors”, waardoor een collectie zowel een dense HNSW-index als een sparse inverted index kan bevatten. Sinds v1.15.2 wordt de IDF-berekening server-side afgehandeld, waardoor Qdrant een serieuze hybrid search concurrent is geworden naast Weaviate.

Gebruik in real-time analytics

Qdrant wordt veelvuldig ingezet in scenario’s waar real-time data-inname vereist is, zoals fraude-detectie of aanbevelingsmotoren voor e-commerce platforms met veel verkeer. Organisaties die op zoek zijn naar een technische AI-demo vinden de prestatie-kostenverhouding van Qdrant vaak een significant voordeel.

Pgvector: De pragmatische keuze voor bestaande PostgreSQL-gebruikers

Pgvector is een PostgreSQL-extensie die vector opslag en similarity search toevoegt aan een standaard relationele database. Het is geen dedicated vector database, maar in 2026 is het een serieuze infrastructuur keuze geworden voor een groot deel van de productie-RAG-implementaties.

Voor de meeste use cases op gematigde schaal presteert pgvector binnen een bestaande PostgreSQL-instantie adequaat en elimineert het de noodzaak om een apart gespecialiseerd systeem te introduceren en te onderhouden. Benchmarks tonen aan dat pgvector met HNSW-indexering zoektijden onder de 20ms behaalt op één miljoen vectoren bij recall-percentages boven de 95%, en pgvectorscale breidt competitieve prestaties uit naar 50 miljoen vectoren en meer.

Belangrijkste voordelen zijn:

- Geen nieuwe infrastructuur: Als je organisatie al PostgreSQL gebruikt, vereist pgvector minimale extra configuratie.

- SQL-compatibiliteit: Vectoren kunnen worden opgevraagd naast relationele data met behulp van standaard SQL, wat de applicatielogica vereenvoudigt.

- Hybride queries: Het combineren van vector similarity search met gestructureerde filters (datums, categorieën, gebruikers-ID’s) is eenvoudig met behulp van bestaande SQL-mogelijkheden.

Pgvector is niet de juiste keuze voor datasets op miljard-schaal of extreem lage latentie-eisen bij zeer hoge query volumes. In die scenario’s bieden dedicated databases zoals Pinecone of Qdrant superieure prestaties en gespecialiseerde indexering. Echter, voor teams die in 2026 reële infrastructuur beslissingen nemen, is starten met pgvector en later migreren een rationeel standaardpad voor de meeste toepassingen.

Milvus: De enterprise-keuze voor implementaties op miljard-schaal

Milvus is een open-source vector database die specifiek is ontworpen voor workloads op enorme schaal. Waar andere databases miljoenen tot tientallen miljoenen vectoren comfortabel verwerken, wordt Milvus routinematig ingezet bij honderden miljoenen tot miljarden vectoren in productie bij zoekmachine bedrijven, e-commerce platforms en genomica-onderzoek.

Milvus 2.6, dat begin 2026 algemeen beschikbaar kwam op Zilliz Cloud, voegt hot/cold tiering toe voor kostenefficiënte archivering en markeert een verschuiving van pure vector search naar een volledige retrieval engine. GPU-versnelde indexering wordt ondersteund.

De afruil is operationele complexiteit. Het draaien van Milvus in productie betekent het gezamenlijk beheren van Kafka, MinIO, etcd en de Milvus-coördinatielaag. De Kubernetes operator vereenvoudigt dit, maar het bevat aanzienlijk meer bewegende delen dan Qdrant of Pinecone. Voor de meeste teams is Milvus “over-engineered”, tenzij ze verwachten te opereren op honderden miljoenen vectoren of de specifieke full-text hybrid search prestaties nodig hebben.

Vergelijking van alle vijf de opties

| Kenmerk | Pinecone | Weaviate | Qdrant | Pgvector | Milvus |

|---|---|---|---|---|---|

| Model type | Volledig beheerd (SaaS) | Open-source / Cloud | Open-source / Cloud | Open-source extensie | Open-source / Cloud |

| Taal | Go (Eigen) | Go | Rust | C | Go / C++ |

| Grootste kracht | Zero-ops serverless | Hybrid search en schema | Prestaties en filtering | Eenvoud voor Postgres-gebruikers | Miljard-schaal projecten |

| Indexering | Eigen graph | HNSW + Inverted Index | HNSW + Quantisatie | HNSW / IVF | Flat, HNSW, IVF, DiskANN |

| Hybrid search | Ja (eigen sparse-dense) | Ja (BM25 + RSF, BlockMax WAND) | Ja (sinds v1.9) | Beperkt (handmatige setup) | Ja (Sparse-BM25) |

| GPU-indexering | Nee | Ja | Ja | Nee | Ja |

| Cloud / on-prem | Cloud + BYOC | Multi-cloud en on-prem | Multi-cloud en on-prem | Overal waar Postgres draait | Multi-cloud en on-prem |

| Beste voor | Gereguleerde enterprise | Complexe data/knowledge graphs | High-throughput, filtering | Teams met bestaande Postgres | 100M+ vector workloads |

Criteria voor het kiezen van een vector database in 2026

1. Schaal

Voor datasets onder de circa 5 tot 50 miljoen vectoren met gemiddelde query volumes is pgvector een redelijk startpunt dat onnodige overhead in de infrastructuur vermijdt. Boven die drempel, of waar query-latentie kritiek is bij een hoge QPS, is een dedicated vector database de extra operationele complexiteit waard. Voor workloads van honderden miljoenen vectoren of meer is Milvus de speciaal hiervoor gebouwde optie.

2. Dataprivacy en soevereiniteit

Als data binnen een specifieke geografische regio of on-premise moet blijven voor naleving van de GDPR, zijn open-source opties zoals Weaviate, Qdrant of Milvus haalbaar, evenals pgvector op je eigen infrastructuur. Pinecone’s BYOC-optie voldoet nu ook aan strikte isolatie-eisen voor organisaties die de voorkeur geven aan een beheerde service.

3. Operationele overhead

Beheerde services zoals Pinecone nemen de noodzaak weg voor database beheerders om sharding, back-ups en index-tuning te verzorgen. Self-hosted Qdrant of Weaviate vereist een intern team om de onderliggende infrastructuur te beheren. Pgvector maakt gebruik van bestaande kennis van PostgreSQL-beheer, waarover de meeste engineering teams al beschikken. Milvus brengt de hoogste operationele last met zich mee van de hier genoemde opties.

4. Query-complexiteit

Applicaties die vertrouwen op exacte keyword matches naast semantische betekenis (bijv. zoeken naar specifieke serienummers in technische handleidingen, of juridisch onderzoek dat semantische gelijkenis combineert met wetsverwijzingen) profiteren van volwassen hybrid search. De implementatie van Weaviate is de meest functie rijke, met Qdrant als een sterk alternatief voor teams die ook nood hebben aan filtering-prestaties. De hybrid search van Pinecone werkt goed binnen het eigen formaat.

Implementatiestrategieën

De overgang naar een vector-first data-strategie vereist een gestructureerde aanpak. Ondernemingen beginnen doorgaans met een AI-strategiesessie om te identificeren welke data-assets het hoogste rendement op investering zullen opleveren wanneer ze worden omgezet in embeddings.

- Data-inname: Reinig en “chunk” ongestructureerde data. Kleine brokken (512 tot 1024 tokens) leveren over het algemeen betere zoekresultaten op.

- Selectie van embeddings: Kies een model (bijv. OpenAI’s text-embedding-3-small of Cohere’s embed-english-v3.0) dat past bij de specifieke taal en het domein van de data.

- Index-optimalisatie: Configureer HNSW-parameters zoals efConstruction en M om een balans te vinden tussen indexering snelheid en zoek nauwkeurigheid.

Conclusie

De selectie van een vector database is een fundamenele beslissing geworden voor de AI-stack van de onderneming, hoewel het juiste antwoord in 2026 in toenemende mate afhangt van de schaal en de bestaande infrastructuur.

Voor de meeste teams die RAG-applicaties op gematigde schaal bouwen, is pgvector binnen een bestaande PostgreSQL-setup het pragmatische startpunt. Pinecone biedt een naadloze, serverless ervaring voor organisaties die prioriteit geven aan snelheid en compliance, waarbij BYOC nu zorgen over data soevereiniteit wegneemt. Weaviate biedt de meest volwassen hybrid search, Relative Score Fusion en knowledge graph-mogelijkheden voor complexe data-omgevingen. Qdrant levert de hoogste prestaties en filtering-efficiëntie voor high-throughput toepassingen, versterkt door het ACORN-algoritme. Milvus is de specialistische optie voor teams die opereren op honderden miljoenen vectoren waar andere databases beginnen te haperen.

Voor organisaties die onzeker zijn over het optimale pad voorwaarts, kan een AI-workshop helpen om deze tools te evalueren tegen specifieke zakelijke vereisten en data-architecturen.

Veelgestelde vragen over Vector Databases

Wat is het verschil tussen een vector database en een traditionele SQL-database?

Traditionele SQL-databases gebruiken tabellen en rijen om gegevens op te slaan en vertrouwen op exacte overeenkomsten voor zoekopdrachten. Vector databases slaan gegevens op als hoog dimensionale punten (vectoren) en gebruiken wiskundige algoritmen om “vergelijkbare” gegevens te vinden op basis van context en betekenis in plaats van exacte tekst overeenkomsten.

Kan ik een reguliere database zoals PostgreSQL gebruiken als vector database?

Ja. De pgvector extensie stelt PostgreSQL in staat om vectoren op te slaan en te doorzoeken, en voor veel productie-RAG-toepassingen presteert dit adequaat. Benchmarks tonen competitieve prestaties tot tientallen miljoenen vectoren met de juiste configuratie. Voor datasets op miljard-schaal of extreem lage latentie-eisen bij zeer hoge queryvolumes bieden gespecialiseerde databases zoals Pinecone of Qdrant doorgaans superieure prestaties.

Hoe werkt de prijsstelling van vector databases?

De prijsstelling is over het algemeen verdeeld tussen opslag (de hoeveelheid geïndexeerde data) en rekenkracht (het aantal verwerkte queries). Serverless modellen, gepionierd door Pinecone, zijn de standaard geworden, waarbij je alleen betaalt voor actief gebruik in plaats van het 24/7 in de lucht houden van een dedicated server.

Waarom is metadata filtering belangrijk?

Metadata-filtering stelt je in staat om een vector zoekopdracht te verfijnen met traditionele criteria. Je kunt het systeem bijvoorbeeld vragen om alle juridische documenten te vinden die lijken op een specifiek document, maar alleen uit het jaar 2025. Dit verhoogt de relevantie van de opgehaalde informatie aanzienlijk.

Heb ik een vector database nodig als ik maar een kleine hoeveelheid data heb?

Voor zeer kleine datasets (minder dan 10.000 documenten) kunnen lokale vector-libraries zoals FAISS voldoende zijn. Voor kleine tot middelgrote productie datasets is pgvector vaak de meest praktische optie. Een dedicated vector database wordt aanbevolen wanneer je hoge prestaties op schaal, strikte latentie eisen onder zware belasting of geavanceerde hybrid zoek functies direct uit de doos nodig hebt.