In het huidige dynamische digitale landschap zijn bedrijven voortdurend op zoek naar innovatieve technologieën om de operationele efficiëntie en klantervaring te verbeteren. Onder de innovaties in AI valt Retrieval-Augmented Generation (RAG) op als een echte game-changer.

Deze blog duikt dieper in Retrieval-Augmented Generation en verkent de mechanismen, de evolutie in 2026 naar Agentic AI en de praktische toepassingen voor bedrijven die op zoek zijn naar geavanceerde oplossingen.

Laten we beginnen!

Wat is RAG?

Retrieval-Augmented Generation, of kortweg RAG, is als een superkrachtige onderzoeksassistent voor je AI-systemen. Het vergroot de toepasbaarheid van Large Language Models (LLM’s) door ze te integreren met de specifieke, realtime kennisbronnen van je organisatie.

Hoe werkt het precies? RAG combineert de krachten van twee belangrijke componenten: een retriever en een generator.

De retriever fungeert als een zoeker die relevante informatie uit je database haalt. Waar dit voorheen sterk gericht was op eenvoudige Vector Databases, is dit nu verschoven naar “Hybrid Retrieval” en “GraphRAG”. Dit betekent dat de retriever niet alleen zoekt naar “gelijkaardige woorden”, maar de complexe relaties tussen je datapunten begrijpt (bijv. hoe een specifieke klant zich verhoudt tot een specifiek project en een specifiek contract).

De generator gebruikt vervolgens deze opgehaalde informatie om nauwkeurige en contextbewuste reacties te formuleren. Het proces begint met een query van de gebruiker. De retriever ontvangt, als een ervaren bibliothecaris, de prompt en doorzoekt een grote kennisbank om relevante documenten te lokaliseren. Daarna wordt een “Reranker”-stap toegevoegd, waarbij een secundaire AI de zoekresultaten dubbelcheckt om te garanderen dat alleen de meest hoogwaardige data de generator bereikt. Deze opgehaalde informatie, gecombineerd met pre-trained modellen, voedt de generator om een antwoord te creëren dat zowel inzichtelijk als betrouwbaar is.

Deze duale aanpak biedt verschillende voordelen:

- Geminimaliseerde foutpercentages: Door reacties te baseren op feiten uit opgehaalde informatie, vermindert RAG het risico op hallucinaties aanzienlijk. Dankzij “Self-Correction”-loops kan de AI zijn eigen antwoord factchecken tegen de bron voordat de gebruiker het te zien krijgt.

- Verbeterd contextueel begrip: RAG blinkt uit in het begrijpen van nuances. Met de komst van Multimodal RAG kunnen systemen nu grafieken, afbeeldingen en technische diagrammen “lezen” naast tekst om een volledig antwoord te geven.

- Actuele relevantie: Door de nieuwste informatie te integreren, zorgt RAG ervoor dat reacties feitelijk juist blijven zonder dat een heel AI-model opnieuw getraind hoeft te worden, een proces dat nog steeds te traag en te duur is voor moderne zakelijke behoeften.

- Privacy & Access control: In tegenstelling tot de “black box”-modellen uit het verleden, zijn RAG-systemen in 2026 gebouwd met Role-Based Access Control (RBAC). Dit garandeert dat de AI alleen informatie ophaalt die de specifieke gebruiker mag zien.

Waarom RAG gebruiken?

Retrieval-Augmented Generation is een belangrijke vooruitgang in NLP. Door de sterke punten van op retrieval gebaseerde modellen en generatieve modellen te combineren, verbetert RAG de algehele kwaliteit en nauwkeurigheid van generatieve AI-reacties.

Het aanpakken van LLM-beperkingen

Traditionele LLM’s zijn beperkt tot de kennis waarop ze zijn getraind, die snel veroudert. RAG lost dit op door LLM’s toegang te geven tot actuele informatie uit externe bronnen. Dit wordt vaak afgehandeld via “Agentic RAG”, waarbij de AI zelfstandig kan besluiten om meer informatie te gaan zoeken als hij merkt dat zijn huidige kennis onvoldoende is om een complexe vraag te beantwoorden.

Hallucinaties verminderen

LLM’s kunnen soms “aannemelijke maar onjuiste” informatie genereren. RAG verzacht dit door reacties te funderen in feitelijke, opgehaalde data. Deze “grounding” is de primaire manier waarop bedrijven vandaag de dag de nauwkeurigheid van 99%+ behalen die vereist is voor juridische of medische toepassingen.

Kosteneffectiviteit

RAG maakt de integratie van nieuwe informatie mogelijk zonder dat het hele model opnieuw getraind hoeft te worden. Zelfs nu “Long Context”-modellen (modellen die meer dan 1 miljoen tokens tegelijk kunnen lezen) gebruikelijk zijn geworden, blijft RAG de meest kosteneffectieve manier om enorme, multi-terabyte bedrijfsarchieven te beheren.

Veelzijdigheid en aanpassingsvermogen

RAG kan worden toegepast in verschillende domeinen, van de gezondheidszorg tot de financiële sector. Het vermogen om contextueel relevante informatie te verstrekken, maakt het een veelzijdige tool voor elke organisatie die vertrouwt op diepgaande documentatie.

Het vergroten van gebruikersvertrouwen

Door verifieerbare citaten en bronnen te verstrekken voor de informatie die in reacties wordt gebruikt, bouwt RAG vertrouwen op bij de gebruiker. Gebruikers kunnen de juistheid van de informatie controleren, wat bijzonder kritisch is onder de richtlijnen van de EU AI Act, die transparantie verplicht stelt bij AI-interacties met grote belangen.

Bedrijfstransformatie: De voordelen van RAG

Verbetering van de nauwkeurigheid van de klantenservice

Klantenservice-bots leveren tijdige, relevante en gepersonaliseerde antwoorden. De bots van vandaag zijn “Agentic”, wat betekent dat ze niet alleen vragen beantwoorden; ze kunnen de specifieke bestelgeschiedenis van een klant ophalen en een probleem in realtime oplossen. Onderzoek wijst uit dat 75% van de klanten loyaal blijft aan bedrijven die uitstekende support bieden, wat bedrijven stimuleert om verder te gaan dan eenvoudige chatbots.

Stroomlijnen van content-personalisatie

Voor content-gedreven bedrijven is RAG een game-changer. Personalisatie van content, gebaseerd op realtime gebruikersdata en gedrag, leidt tot hogere betrokkenheid. RAG stelt je in staat om marketingcampagnes of productaanbevelingen te creëren die “door mensen gecureerd” aanvoelen, omdat ze gebaseerd zijn op de werkelijke geschiedenis van de gebruiker.

Minimaliseren van fouten en verbeteren van besluitvorming

Door gebruik te maken van grote datasets minimaliseert RAG fouten in dataverwerking. De verbeterde ondersteuning bij besluitvorming door GraphRAG, die organisatorische verbindingen in kaart brengt, maakt de weg vrij voor betere bedrijfsresultaten in complexe velden zoals wereldwijde logistiek of de ontwikkeling van geneesmiddelen.

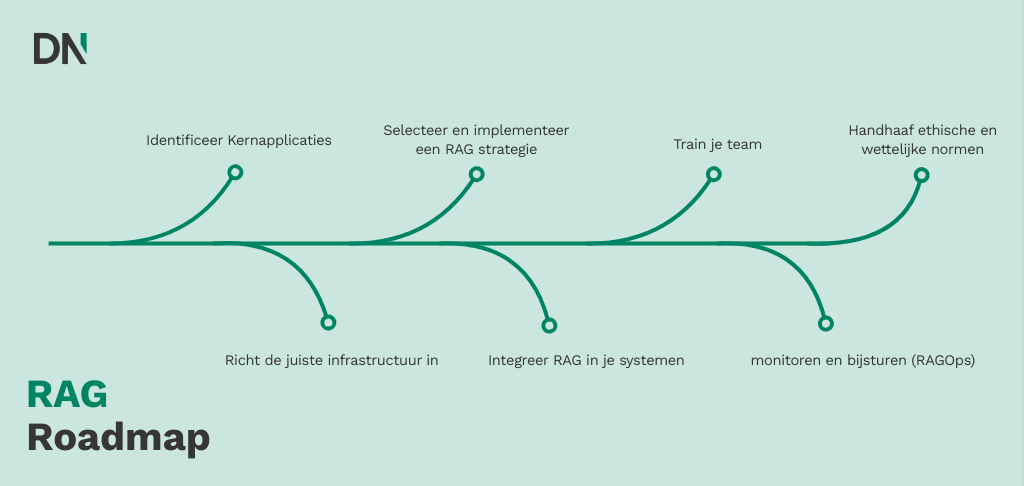

RAG implementeren: Een praktische roadmap voor 2026

1. Identificeer kernapplicaties

Beoordeel waar RAG de meeste waarde kan leveren.

- Interne kennisbank: Verander duizenden interne PDF’s in een doorzoekbaar “Bedrijfsbrein”.

- Regulatory compliance: Gebruik RAG om nieuwe wetgeving te monitoren en te toetsen aan het bedrijfsbeleid.

2. Richt de juiste infrastructuur in

Hoewel krachtige servers belangrijk zijn, is de focus verschoven naar Serverless Vector Data en Model Context Protocols (MCP). Hiermee kan je AI “praten” met je data op de plek waar deze al staat (SharePoint, Google Drive, SQL), zonder dat deze naar een nieuwe locatie verplaatst hoeft te worden.

3. Selecteer en implementeer een RAG-strategie

Kies een strategie die aansluit bij je data:

- Hybrid search: Essentieel voor standaard tekstdocumenten.

- GraphRAG: Ideaal voor scenario’s die nauwkeurige relatiemapping vereisen, zoals juridisch onderzoek of supply chain management.

- Multimodal RAG: Noodzakelijk als je data afbeeldingen, blauwdrukken of video bevat.

4. Integreer RAG in je systemen

- API-integratie: Verbind RAG-mogelijkheden naadloos met je bestaande CRM of ERP.

- Agentic Workflows: Richt je systeem zo in dat de AI kan “nadenken” en meerdere zoekopdrachten kan uitvoeren om het juiste antwoord te vinden.

5. Train je team

Voorzie je team van “AI-geletterdheid”. Technisch personeel moet Retrieval Evaluation begrijpen, terwijl operationeel personeel moet leren hoe ze de AI moeten prompten om de beste resultaten uit de opgehaalde data te halen.

6. Monitoren en bijsturen (RAGOps)

Implementeer “RAGOps” om de effectiviteit te volgen. Beoordeel regelmatig metrieken zoals “Faithfulness” (houdt de AI zich aan de feiten?) and “Relevance” (is de opgehaalde info daadwerkelijk nuttig?).

7. Handhaaf ethische en wettelijke normen

Zorg ervoor dat je RAG-deployment voldoet aan de nieuwste AI-richtlijnen. In 2026 omvat dit Data Sovereignty (garanderen dat je data in de eigen regio blijft) en transparantie (bekendmaken wanneer een antwoord door AI is gegenereerd).

Tot slot: De toekomst omarmen met RAG

Naarmate de technologie voortschrijdt, wordt het integreren van geavanceerde tools zoals RAG steeds crucialer voor bedrijven die streven naar transformatieve groei. RAG stelt bedrijven in staat om relevant te blijven, alerter te reageren en veerkracht op te bouwen in een AI-first wereld.Als je RAG-oplossingen in je bedrijf wilt implementeren, is onze RAG Readiness Assessment service wellicht interessant, waarbij we je organisatie afstemmen op de best practices om de beste resultaten uit je tools te halen. Als je al een specifieke tool wilt ontwikkelen die RAG implementeert, kunnen we daar ook bij helpen; kijk daarvoor naar onze AI Development service.

Is RAG nog steeds nodig nu “Long Context”-modellen (1M+ tokens) gebruikelijk zijn?

Ja. Hoewel modellen zoals Gemini 3.0 een volledig archief in één keer kunnen “lezen”, blijft RAG superieur om drie redenen:

Snelheid: RAG levert antwoorden binnen een seconde, terwijl het verzadigen van een massief contextvenster kan leiden tot latenties van 30–60 seconden.

Nauwkeurigheid: Large Language Models (LLM’s) hebben nog steeds last van de “Lost in the Middle”-bias. RAG zorgt ervoor dat de meest relevante data precies daar wordt geplaatst waar de aandacht van het model het scherpst is.

Kosten: RAG is ongeveer 1.250x goedkoper per query. Het telkens verwerken van 1 miljoen tokens wanneer je een simpele vraag stelt, is financieel onhoudbaar op schaal.

Wat is het verschil tussen Vector Search en GraphRAG?

Standaard Vector Search vindt informatie op basis van “semantische gelijkenis” (bijv. het vinden van documenten over “auto’s” wanneer je zoekt op “voertuigen”). GraphRAG brengt de feitelijke relaties tussen entiteiten in kaart (bijv. “Onderdeel A” wordt “geproduceerd door” “Bedrijf B”, dat “gevestigd is in” “Regio C”). Belangrijke regel: Gebruik Vector Search voor eenvoudige zoekopdrachten. Gebruik GraphRAG wanneer je vragen meerstaps redeneringen vereisen over je data heen (bijv. “Welke van onze leveranciers worden beïnvloed door de nieuwe regelgeving in Frankrijk?”).

Hoe verschilt “Agentic RAG” van een standaard AI-chatbot?

Een standaard chatbot is reactief; deze haalt informatie op en vat deze samen. Agentic RAG is proactief. Als de AI beseft dat de eerste zoekopdracht geen volledig antwoord opleverde, kan deze autonoom besluiten om:

- Een andere database te doorzoeken.

- Op het web te surfen voor realtime nieuws.

- Twee verschillende documenten te vergelijken om een discrepantie te vinden.

Het “denkt” in feite na over het onderzoeksproces in plaats van alleen een enkele zoekopdracht op trefwoorden uit te voeren.

Wat is de typische ROI voor een RAG-implementatie in 2026?

De meeste ondernemingen zien ROI op drie belangrijke gebieden:

Lagere supportkosten: Agentic bots kunnen 70-80% van de eerstelijns vragen oplossen door direct toegang te krijgen tot bestelgeschiedenissen en handleidingen.

Geen kosten voor hertraining: Je kunt de kennis van je AI direct bijwerken door een bestand aan je database toe te voegen, waardoor je de miljoenenkosten voor het Fine-tuning van een model vermijdt.

Kortere “Time-to-Insight”: Analisten besteden 60% minder tijd aan het zoeken naar data in versnipperde PDF’s en e-mails.

Hoe helpt RAG bij de naleving van de EU AI Act?

Onder de EU AI Act (volledig handhaafbaar vanaf augustus 2026) moeten AI-systemen met een hoog risico transparant en uitlegbaar zijn. RAG biedt dit “by design” via citaten. Omdat de AI put uit specifieke documenten, kan deze een directe link of voetnoot naar het bronmateriaal leveren, waardoor een human-in-the-loop het antwoord kan verifiëren.

Hoe wordt dataprivacy afgehandeld in een RAG-systeem?

In 2026 gebruiken we Role-Based Access Control (RBAC). Wanneer een gebruiker de AI een vraag stelt, controleert de retriever eerst de inloggegevens van die gebruiker aan de hand van de machtigingen van het bedrijf (bijv. SharePoint- of SQL-toegang). De AI “ziet” en haalt alleen de data op die de specifieke werknemer mag inzien, wat lekken van gevoelige data voorkomt.