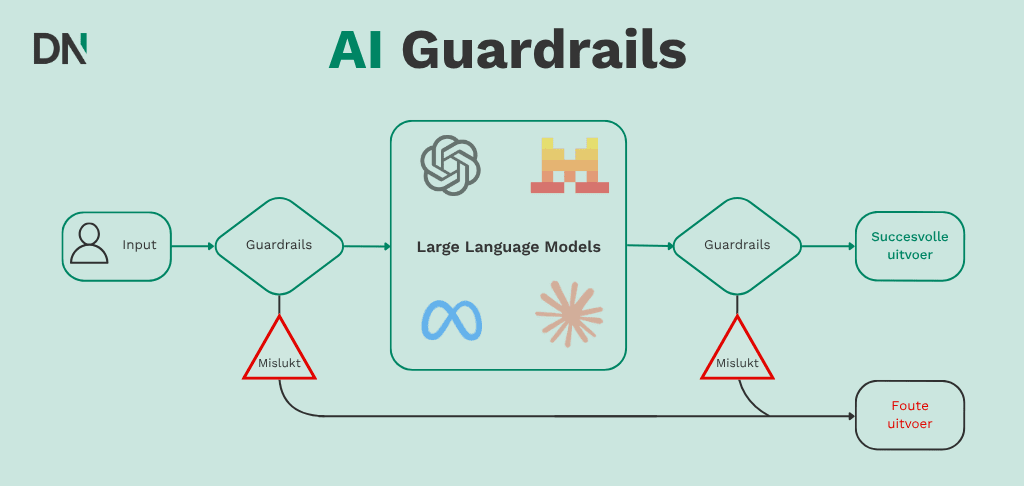

AI-guardrails zijn technische en beleidsmatige filters die de in- en output van Large Language Models bewaken en beheersen. In een zakelijke context dienen deze guardrails als de primaire defensieve laag die ervoor zorgt dat AI-systemen binnen gedefinieerde veiligheids-, beveiligings- en ethische grenzen opereren. Naarmate organisaties overstappen van pilotprojecten naar AI-implementatie, is de noodzaak voor robuuste guardrails essentieel voor risicomanagement.

Het ongecontroleerd inzetten van LLM’s brengt drie belangrijke bedrijfsrisico’s met zich mee:

- Het genereren van feitelijk onjuiste informatie (hallucinaties),

- De ongeoorloofde blootstelling van gevoelige gegevens (PII-lekken),

- De ondermijning van modelinstructies door kwaadwillende actoren (prompt-injecties).

Het beheersen van deze risico’s vereist een gelaagde architectuur in plaats van een eenmalige softwareoplossing.

Het mechanisme van AI-guardrails

Guardrails zijn in feite een tussenlaag, vaak een “shim” of “proxy” genoemd, die zich tussen de gebruiker en het LLM bevindt. Wanneer een gebruiker een query indient, analyseert het guardrail-systeem de input op kwaadaardige intenties of gevoelige gegevens voordat deze het model bereikt. Op dezelfde manier evalueert de guardrail, voordat de respons van het model aan de gebruiker wordt gepresenteerd, de output op nauwkeurigheid, toon en naleving.

Onderzoek van de Carnegie Mellon University (Costa et al., 2025) maakt onderscheid tussen neurale guardrails, die secundaire modellen gebruiken om de output te beoordelen, en symbolische guardrails, die deterministische code en logica gebruiken om sterkere beveiligingsgaranties te bieden. Voor ondernemingen is doorgaans een combinatie van beide vereist om een evenwicht te bewaren tussen de bruikbaarheid van het model en de veiligheid van het systeem.

Mitigatie van LLM-hallucinaties

Een LLM-hallucinatie treedt op wanneer een model tekst genereert die syntactisch correct is, maar feitelijk onjuist of onzinnig. In zakelijke omgevingen kunnen hallucinaties in klantgerichte bots of interne besluitvormingsinstrumenten leiden tot juridische aansprakelijkheid en operationele fouten.

Retrieval Augmented Generation (RAG)

Een van de meest effectieve methoden om hallucinaties te verminderen is Retrieval Augmented Generation (RAG). In plaats van te vertrouwen op de interne gewichten van het model (parametrisch geheugen), dwingt RAG het model om informatie op te halen uit een geverifieerde interne database voordat het een antwoord genereert. Dit verankert de output in de bedrijfseigen data van de organisatie.

Verificatielagen

Bedrijven kunnen geautomatiseerde verificatie pipelines implementeren die de output van het model vergelijken met brondocumenten. Volgens technische documentatie van Ksolves gebruiken deze lagen controles op semantische gelijkenis en ‘groundedness’-evaluaties om antwoorden met een laag vertrouwen te markeren. Als een antwoord niet aan een specifieke betrouwbaarheidsscore voldoet, kan het systeem een fallback-bericht activeren, zoals “Ik heb niet genoeg informatie om deze vraag te beantwoorden”, in plaats van een gefabriceerd antwoord te geven.

Tool calling en API-routing

Door het LLM te configureren als een router in plaats van als een bron van waarheid, wordt een hele categorie hallucinaties geëlimineerd. Als een gebruiker bijvoorbeeld om een specifieke prijs vraagt, onderschept de guardrail de intentie en stuurt de query via een API naar een facturatie-database, in plaats van het model de prijs te laten “raden” op basis van zijn trainingsdata.

Het voorkomen van PII-lekken en data-exfiltratie

Lekken van Personally Identifiable Information (PII) treden op wanneer gevoelige gegevens (bijv. burgerservicenummers, creditcardgegevens of medische dossiers) naar een externe LLM-provider worden verzonden of verschijnen in het antwoord van een model aan een onbevoegde gebruiker.

Redactie op gateway-niveau

Het implementeren van een PII-filterbeleid op het niveau van de API-gateway zorgt ervoor dat gevoelige gegevens worden gedetecteerd en geanonimiseerd voordat ze het bedrijfsnetwerk verlaten. Oplossingen zoals Gravitee en Google Cloud Model Armor gebruiken patroonherkenning en Machine Learning om gevoelige entiteiten te vervangen door placeholders (bijv. het vervangen van “Jan Janssen” door “[NAAM]”).

Het risico van model-memorizing

Grote modellen hebben aangetoond dat ze in staat zijn segmenten van hun trainingsdata te “onthouden”. Als een bedrijf een AI model afstemming geeft op interne documenten die niet goed zijn geschoond, kan het model onbedoeld die gegevens onthullen wanneer het wordt geprompt door een slimme gebruiker. Dit maakt een strikte AI-assessment van alle datasets noodzakelijk voordat ze worden gebruikt voor training of fine-tuning.

| Preventiemethode | Implementatielaag | Belangrijkste voordeel |

|---|---|---|

| Data Masking | Input Proxy | Voorkomt dat PII de modelprovider bereikt. |

| Output Scanning | Output Proxy | Stopt gevoelige data voordat deze de eindgebruiker bereikt. |

| RBAC | Retrieval-laag | Zorgt dat gebruikers alleen ‘chatten’ met data waarvoor ze geautoriseerd zijn. |

| Formaatversleuteling | Database | Beschermt data in rust binnen de RAG-index. |

Verdediging tegen prompt-injecties

Prompt-injectie is een kwetsbaarheid in de beveiliging waarbij een gebruiker input geeft die is ontworpen om de systeeminstructies van de AI te overschrijven. Deze worden onderverdeeld in directe injecties (jailbreaking) en indirecte injecties (waarbij het model kwaadaardige instructies consumeert uit een externe bron, zoals een website of een PDF).

Het onderscheid tussen “Systeem vs. Gebruiker” prompts

Moderne LLM-architecturen, zoals die van OpenAI’s ChatGPT en Anthropic’s Claude, proberen door ontwikkelaars gedefinieerde systeeminstructies te scheiden van door gebruikers geleverde content. Deze scheiding is echter niet absoluut. Guardrails verzachten dit door “canary tokens” (verborgen tekenreeksen) te gebruiken om te detecteren of de output van een model is afgeweken van het beoogde pad.

Defensieve Prompt Engineering

Bedrijven maken gebruik van gestructureerde Prompt Engineering om expliciete onzekerheidskaders in te stellen. Door “Few-shot” voorbeelden te geven van hoe om te gaan met kwaadaardige queries, wordt het model resistenter tegen manipulatie. Organisaties verfijnen deze technieken vaak tijdens een speciale AI-workshop om ervoor te zorgen dat hun specifieke edge-cases worden gedekt.

Input-sanitisatie en lengtebeperkingen

Net zoals SQL-injectie wordt beperkt door inputs te saneren, kan het risico op prompt-injectie worden verminderd door de lengte en complexiteit van gebruikersinputs te beperken. Door de input te beperken tot specifieke formaten (bijv. JSON of platte tekst zonder speciale tekens) wordt het aanvalsoppervlak voor “jailbreak”-pogingen verkleind.

Strategische implementatie van guardrails

De inzet van guardrails is niet louter een technische taak; het is een governance-functie. De Voluntary AI Safety Standard van de Australische overheid stelt dat verantwoordelijkheid niet kan worden uitbesteed. De bedrijfsleiding moet definiëren wie verantwoordelijk is voor het gedrag van het AI-systeem en ervoor zorgen dat AI-training wordt gegeven aan personeel om anomalieën te herkennen en te rapporteren.

Monitoring en observeerbaarheid

Guardrails leveren de data die nodig is voor continue monitoring. Door elke geblokkeerde injectiepoging en elk geredigeerd PII-geval te loggen, kunnen beveiligingsteams patronen van misbruik identificeren. Deze data is cruciaal voor het handhaven van naleving van regelgeving zoals de EU AI Act, die een hoog niveau van transparantie en risicomanagement vereist voor “hoog-risico” AI-systemen.

Voor organisaties die niet weten waar ze moeten beginnen, kan een Proof of Concept (PoC) de effectiviteit van deze guardrails aantonen in een gecontroleerde omgeving voordat een volledige uitrol plaatsvindt.

Conclusie

De integratie van AI in zakelijke workflows biedt meetbare winst in productiviteit, maar deze winst is afhankelijk van het behoud van vertrouwen en veiligheid. Hallucinaties, PII-lekken en prompt-injecties vormen de primaire technische hindernissen voor grootschalige adoptie. Door een gelaagde guardrail-architectuur te implementeren, variërend van RAG-gebaseerde verankering tot PII-filtering op gateway-niveau, kunnen organisaties deze risico’s effectief beperken. Naarmate het AI-landschap evolueert, zal de proactieve toepassing van deze controles veerkrachtige ondernemingen onderscheiden van ondernemingen die zijn blootgesteld aan de inherente volatiliteit van generatieve modellen.

Veelgestelde vragen (FAQ)

Kunnen guardrails LLM-hallucinaties volledig elimineren?

Nee, guardrails kunnen de mogelijkheid van een hallucinatie niet volledig elimineren vanwege de probabilistische aard van LLM’s. Door gebruik te maken van RAG en verificatielagen, kunnen bedrijven de frequentie van hallucinaties verminderen en ervoor zorgen dat het systeem onzekerheid toegeeft in plaats van valse informatie te verstrekken.

Vertragen AI-guardrails de responstijd voor gebruikers?

Het toevoegen van een guardrail-laag introduceert een kleine hoeveelheid latentie (meestal gemeten in milliseconden), omdat het systeem de input en output moet scannen. Voor de meeste zakelijke toepassingen is deze vertraging echter verwaarloosbaar vergeleken met de voordelen op het gebied van beveiliging en naleving.

Is PII-masking nodig als we een private instantie van een LLM gebruiken?

Ja. Zelfs als de data je private cloud-omgeving niet verlaat, is PII-masking noodzakelijk om te voorkomen dat het model gevoelige gegevens “leert” die onthuld zouden kunnen worden aan andere interne gebruikers die niet over de juiste bevoegdheden beschikken. Dit is een kernonderdeel van interne data-governance.

Wat is het verschil tussen een directe en een indirecte prompt-injecties?

Een directe prompt-injectie vindt plaats wanneer een gebruiker expliciet probeert de AI te misleiden (bijv. “Negeer alle eerdere instructies”). Een indirecte prompt-injectie gebeurt wanneer de AI een document of webpagina verwerkt die verborgen kwaadaardige instructies bevat, bedoeld om het gedrag van het model te kapen.

Hoe vaak moeten AI-guardrails worden bijgewerkt?

Guardrails moeten continu worden geëvalueerd en bijgewerkt. Naarmate er nieuwe “jailbreak”-technieken worden ontdekt en het datalandschap van een organisatie verandert, moeten de filters en regels worden aangepast om nieuwe kwetsbaarheden aan te pakken. Regelmatige AI-assessments worden aanbevolen om een hoog beveiligingsniveau te handhaven.