Cache Augmented Generation (CAG) is een innovatief architectonisch framework voor Large Language Models (LLM’s). Waar traditionele methoden afhankelijk zijn van het real-time ophalen van data, laadt CAG een specifieke kennisbank direct in het context window van het model. De resulterende computationele berekeningen worden vervolgens opgeslagen in een herbruikbare cache.

Door deze aanpak is het niet langer nodig om tijdens de inference-fase gegevens extern op te halen. Dit zorgt voor een aanzienlijke vermindering van zowel de latentie als de complexiteit van het systeem. Nu bedrijven de prestaties van hun AI-toepassingen verder willen optimaliseren, biedt CAG een gespecialiseerde oplossing voor scenario’s waarin informatie stabiel is en een hoge reactiesnelheid cruciaal is. Dankzij de enorme context windows van moderne modellen verschuift CAG de zware dataverwerking van de query-fase naar een eenmalige, offline initialisatiefase.

Wat is cache augmented generation?

Cache augmented generation (CAG) is een methode om LLM’s te verankeren in externe data door een gecureerde dataset te coderen in een Key-Value (KV) cache voordat er enige gebruikersinteractie plaatsvindt. In dit paradigma “onthoudt” het model de verstrekte documenten binnen zijn werkgeheugen (het context window) in plaats van ernaar te zoeken in een externe database tijdens runtime.

De mechanica van CAG

De kern van CAG ligt in het attention-mechanisme van de Transformer-architectuur. Wanneer een model tekst verwerkt, genereert het KV-paren voor elke token om relaties te berekenen. CAG voert deze berekening één keer uit voor de gehele kennisbank en slaat deze toestanden op. Wanneer een gebruiker een vraag stelt, hoeft het model alleen de KV-paren voor de nieuwe query te berekenen, waarbij het onmiddellijk gebruikmaakt van de bestaande cache om een reactie te genereren.

Waarom CAG belangrijk wordt voor AI

De verschuiving naar CAG wordt gedreven door de evolutie van LLM-hardware en softwarecapaciteiten. Nu context windows zijn uitgebreid van 4.000 tokens naar meer dan 1.000.000 tokens in modellen zoals Gemini 1.5 Pro, is de noodzaak om kleine stukjes data op te halen (“retrieving”) voor veel use cases afgenomen.

1. Eliminatie van retrieval-latentie

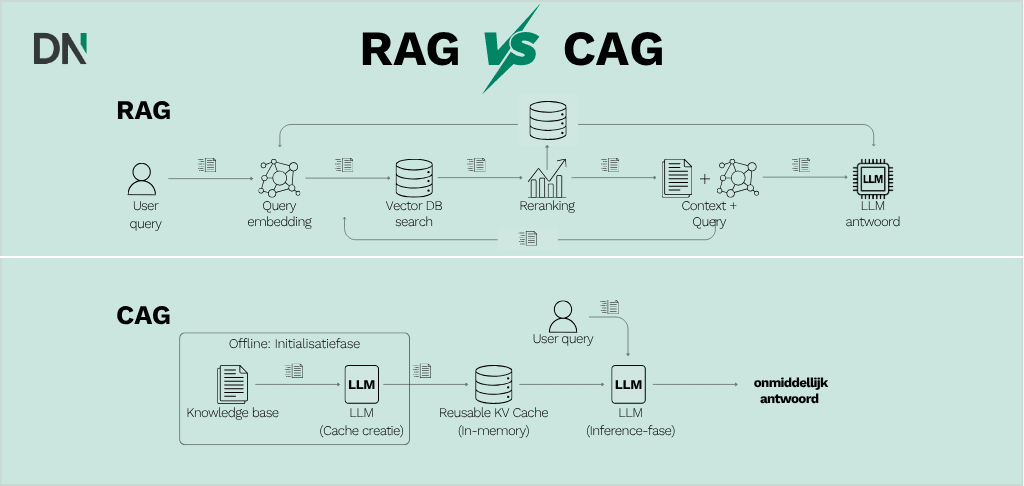

In een standaard Retrieval-augmented generation (RAG) opstelling triggert elke query een proces in meerdere stappen: het embedden van de query, het doorzoeken van een vector database, het reranken van resultaten en ten slotte het genereren van tekst. Elke stap voegt milliseconden of seconden vertraging toe. CAG verwijdert deze tussenstappen, wat bijna onmiddellijke reacties mogelijk maakt omdat de data al in de inference-toestand van het model is “geladen”.

2. Verminderde architectonische complexiteit

Het beheren van een RAG-pipeline vereist het onderhouden van een vector database (bijv. Pinecone, Weaviate), embedding-modellen en complexe data-ingestie workflows. Organisaties die hun data niet elke minuut hoeven bij te werken, kunnen deze infrastructuur omzeilen door CAG te gebruiken. Deze eenvoud vermindert het aantal potentiële storingspunten in een productieomgeving.

3. Verbeterde contextuele coherentie

RAG-systemen hebben vaak last van “lost in the middle”-problemen of gefragmenteerde context omdat ze het model alleen voorzien van kleine, losstaande fragmenten van documenten. CAG biedt het model de volledigheid van de relevante kennisbank in één coherent blok. Dit stelt de LLM in staat om betere multi-hop redeneringen uit te voeren en feiten te verbinden die in verschillende delen van een handleiding of beleidsdocument staan.

Technische vergelijking: CAG vs. RAG

De keuze tussen deze twee architecturen hangt af van het datavolume en de frequentie van updates.

| Kenmerk | Retrieval-augmented generation (RAG) | Cache augmented generation (CAG) |

| Databron | Externe vector database | Vooraf geladen in-memory KV-cache |

| Inference-latentie | Hoger (inclusief retrieval-tijd) | Zeer laag (directe generatie) |

| Kennisupdates | Real-time (update de DB) | Statisch (vereist cache-refresh) |

| Datavolume | Schaalt naar miljarden documenten | Beperkt door context window van model |

| Systeemcomplexiteit | Hoog (DB’s, retrievers, loaders) | Laag (model en cachebestand) |

| Kosten per query | Hoger (extra rekenkracht voor retrieval) | Lager (hergebruikt vooraf berekende toestanden) |

Kernfasen van een CAG-implementatie

Het implementeren van CAG volgt een gestructureerde levenscyclus van drie stappen: preloading, inference en beheer.

Fase 1: Kennis preloading

In deze fase worden documenten gecureerd, geformatteerd in een enkele prompt en door de LLM gehaald. Het systeem legt de KV-cache vast die tijdens deze forward pass wordt geproduceerd. Een bedrijf kan bijvoorbeeld alle 50.000 woorden van zijn personeelshandboek vooraf laden. Dit zijn eenmalige berekeningskosten.

Fase 2: Inference en query-afhandeling

Wanneer een gebruiker een query indient, wordt de vooraf berekende KV-cache in het geheugen van het model geladen samen met de query-tokens. Het model genereert het antwoord met behulp van de opgeslagen attention-toestanden, wat betekent dat het het handboek niet opnieuw hoeft te lezen om het antwoord te vinden. Het “kijkt” simpelweg in zijn bestaande geheugen.

Fase 3: Cachebeheer en resetten

Om geheugenoverloop of “contextvervuiling” door eerdere queries te voorkomen, moet de cache worden beheerd. Gespecialiseerde opschoonfuncties korten de cache na elke interactie in tot de oorspronkelijke “alleen-kennis”-toestand, zodat het model gefocust blijft op de primaire databron voor de volgende gebruiker.

Praktische zakelijke toepassingen

CAG is geen universele vervanging voor RAG, maar het is superieur in verschillende specifieke enterprise-contexten.

Klantenservice en FAQ-bots

De meeste klantvragen hebben betrekking op een statische set producthandleidingen of verzendbeleid. Door CAG te gebruiken, kunnen bedrijven onmiddellijke ondersteuningservaringen bieden zonder de vertraging die gepaard gaat met het doorzoeken van een database voor elke “Hoe retourneer ik mijn artikel?”-vraag. Organisaties die deze hogesnelheidsinterfaces willen implementeren, beginnen vaak met een AI Assessment om te bepalen of hun datavolume binnen de huidige contextlimieten past.

Interne beleids- en compliance-assistenten

HR- en juridische afdelingen hebben vaak datasets met een hoge waarde maar een beperkt volume (bijv. 20-50 PDF’s met regelgevingsrichtlijnen). CAG stelt een AI-assistent in staat om deze documenten perfect te onthouden, wat garandeert dat compliance-antwoorden verankerd zijn in de volledige tekst van de wet in plaats van een opgehaalde samenvatting.

Gepersonaliseerde SaaS-onboarding

Softwareplatforms kunnen CAG gebruiken om de specifieke accountconfiguratie van een gebruiker en de software-documentatie vooraf te laden. Dit maakt een zeer gepersonaliseerde AI-“gids” mogelijk die de specifieke context van de gebruiker begrijpt met nul latentie terwijl deze door de app navigeert. Het implementeren van deze geavanceerde architecturen vereist doorgaans gespecialiseerde AI implementation services om het onderliggende KV-cachebeheer af te handelen.

Huidige beperkingen en uitdagingen

Hoewel CAG aanzienlijke prestatievoordelen biedt, kampt het met twee primaire beperkingen:

- Context window-limieten: Zelfs met windows van 1 miljoen tokens is er een grens aan hoeveel data vooraf geladen kan worden. Als een kennisbank meer dan enkele honderden boeken aan tekst bevat, blijft RAG de noodzakelijke keuze.

- Veroudering van kennis: Omdat de cache vooraf wordt berekend, vereisen wijzigingen in de onderliggende documenten dat de cache opnieuw wordt opgebouwd. Voor data die elk uur verandert (zoals aandelenkoersen of nieuws), is CAG niet effectief, tenzij het wordt gecombineerd met een hybride retrieval-systeem.

Om dit te verzachten, experimenteren sommige ontwikkelaars met Hybride CAG-RAG Frameworks, waarbij een kern van “stabiele” kennis wordt gecached, maar een lichtgewicht retriever wordt getriggerd als de query informatie buiten die cache vereist.

Conclusie

Cache augmented generation vertegenwoordigt een verschuiving van “zoeken-dan-genereren” naar “laden-dan-genereren”. Door gebruik te maken van het uitgebreide geheugen van moderne LLM’s en de efficiëntie van KV-caching, organiseren…Cache augmented generation represents a shift from “search-then-generate” to “load-then-generate.” By leveraging the expanded memory of modern LLMs and the efficiency of KV caching, organizations can achieve up to 40x faster generation times and 70% reductions in compute costs for stable knowledge tasks. As context windows continue to grow, CAG will likely become the standard architecture for domain-specific AI applications that prioritize speed and reliability over massive, ever-changing data scales.

Veelgestelde vragen (FAQ)

Hoe verlaagt CAG de kosten in vergelijking met RAG?

CAG verlaagt de kosten door de noodzaak voor embedding-modellen en vector-databasequeries bij elke gebruikersinteractie te elimineren. Hoewel de initiële preloading-fase kosten met zich meebrengt, zijn de computationele vereisten per query lager omdat het model voorberekende attention-states hergebruikt.

Kan CAG real-time data-updates verwerken?

Nee. CAG is ontworpen voor statische of semi-statische datasets. Als je data vaak verandert, moet je ofwel de cache opnieuw genereren (wat tijd kost), of een RAG-architectuur gebruiken die de meest recente gegevens ophaalt uit een live database.

Wat is de maximale omvang van de data voor een CAG-systeem?

De limiet wordt bepaald door het context window van het LLM. Voor een model met een limiet van 128.000 tokens kun je ongeveer 95.000 woorden opslaan. Voor een model met een limiet van 1.000.000 tokens kun je bijna 750.000 woorden opslaan (de omvang van meerdere dikke romans).

Verbetert CAG de nauwkeurigheid?

CAG kan de nauwkeurigheid verbeteren bij taken die multi-hop redeneren vereisen, omdat het model de volledige documentenset in één keer ziet. RAG faalt soms als de relevante informatie is verdeeld over verschillende chunks die de retriever niet gelijktijdig selecteert.