Aan het begin van de opkomst van generatieve AI ging de meeste aandacht uit naar “prompt engineering“. Dit houdt in dat je de perfecte manier zoekt om een vraag of verzoek te formuleren, zodat je de beste reactie van het model krijgt. Nu bedrijven AI echter serieuzer en op grotere schaal beginnen te gebruiken, is er een ander belangrijk gebied in beeld gekomen: Context Engineering.

Terwijl prompt engineering gaat over hoe je iets vraagt, gaat context engineering over wat de AI weet wanneer je het vraagt. Het draait om het zorgvuldig organiseren en beheren van de informatie rondom een Large Language Model (LLM), zodat de antwoorden die het geeft accuraat en relevant zijn en aansluiten bij de bedrijfsdoelstellingen.

Wat is Context Engineering?

Simpel gezegd gaat het om het ontwerpen en beheren van de data, instructies en achtergrondinformatie die aan een AI-model worden verstrekt wanneer het antwoorden genereert (het “Context window“). In tegenstelling tot een menselijke werknemer die de producten, de tone of voice en de klantachtergrond van je bedrijf kent, heeft een LLM zoals GPT-5.2 of Claude 4.5 die kennis niet ingebouwd. Context engineering vult dat gat door systemen te creëren die relevante data, documenten en eerdere interacties kunnen ophalen precies op het moment dat ze nodig zijn.

Het doel hier is om van een basis redeneermodel een gespecialiseerde expert in jouw vakgebied te maken, zonder de kosten en moeite om vanaf nul te beginnen.

De drie lagen van context

Een succesvol context engineering-plan omvat doorgaans drie belangrijke informatielagen:

- Systeemcontext: Dit is de set richtlijnen die definieert hoe de AI moet functioneren, inclusief gedrag en ethische normen. Het kan bijvoorbeeld stellen dat de AI een klantenservicemedewerker is voor een specifiek bedrijf en nooit financieel advies mag geven.

- Retrieval-context: Dit betreft de toegang tot realtime data uit verschillende bronnen, zoals PDF’s of databases, om de AI van actuele informatie te voorzien bij het reageren. Hiervoor worden technieken zoals Retrieval-Augmented Generation (RAG) gebruikt.

- Sessiecontext: Dit verwijst naar het bijhouden van de gespreksgeschiedenis, waardoor het model kan onthouden wat er in eerdere interacties is gezegd.

Het is belangrijk op te merken dat context engineering niet gaat over het hertrainen van het model zelf; het gaat over het fine-tunen van de data-input om de kwaliteit van de output te verbeteren. Om dit goed te doen, heb je een mix nodig van data science, vaardigheden in softwareontwikkeling en taalbegrip.

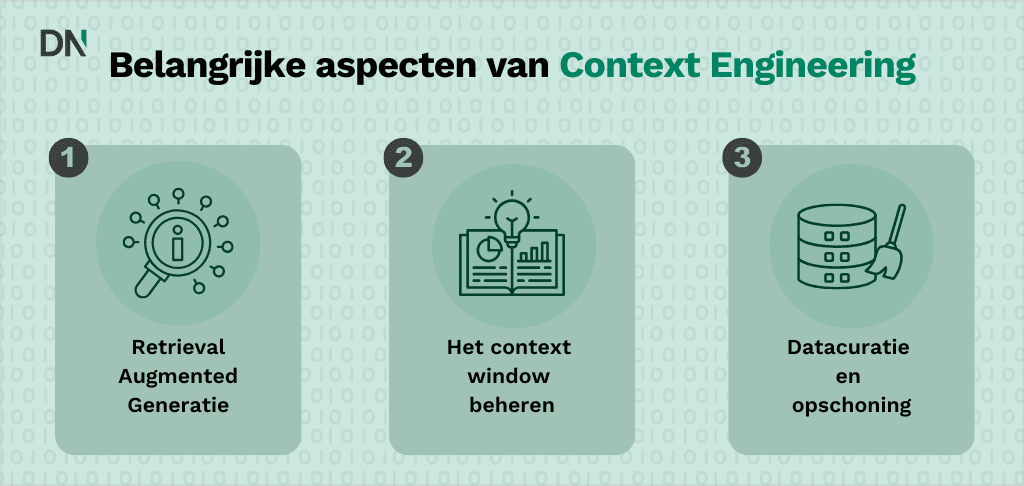

Belangrijke aspecten van context engineering

Effectieve context engineering vereist een mix van data science, software architectuur en linguïstische strategie.

1. Retrieval-Augmented Generation (RAG)

RAG is de technische ruggengraat van de meeste context engineering-strategieën. Het stelt de AI in staat om informatie “op te zoeken” voordat hij antwoord geeft. Wanneer een gebruiker een vraag stelt, doorzoekt het systeem eerst een vectordatabase om relevante bedrijfsdocumenten te vinden en plakt deze documenten vervolgens in het context window, samen met de vraag van de gebruiker. Het implementeren van high-performance RAG vereist gespecialiseerde Generatieve AI-ontwikkeling om ervoor te zorgen dat de opgehaalde data daadwerkelijk relevant zijn. Slechte retrieval leidt tot “garbage in, garbage out”.

2. Het context window beheren

Elke LLM heeft een “context window”. Dit is een strikte limiet op hoeveel tekst het in één keer kan verwerken (gemeten in tokens). Hoewel nieuwere modellen zoals Google’s Gemini 1.5 Pro enorme context windows hebben (tot 1 miljoen tokens), is het gevaarlijk om deze willekeurig te vullen. Onderzoekers hebben het “Lost in the Middle”-fenomeen geïdentificeerd, waarbij LLM’s de neiging hebben informatie te negeren die in het midden van een groot blok tekst begraven ligt, en zich voornamelijk focussen op het begin en het einde. Een bekwame context engineer structureert data om dit te beperken en plaatst kritische instructies daar waar het model waarschijnlijk de meeste “aandacht” heeft.

3. Datacuratie en opschoning

Context engineering begint lang voordat de prompt wordt verstuurd. Het begint bij de gereedheid van de data. Als je kennisbank verouderde PDF’s of tegenstrijdig beleid bevat, kan er iets gebeuren dat een AI hallucinatie wordt genoemd, of kan het model onjuiste antwoorden geven. Een AI haalbaarheidsanalyse is vaak de eerste stap om te bepalen of je data-infrastructuur klaar is om context engineering te ondersteunen.

Context Engineering vs. Prompt Engineering

Deze twee termen worden vaak door elkaar gehaald, maar ze vervullen verschillende rollen in de AI-stack. Prompt Engineering is het verfijnen van de instructie. Het is gebruikersgericht en tactisch. Context Engineering is het verfijnen van de omgeving. Het is systeemgericht en strategisch.

Zie de LLM als een briljante universiteitsstudent die een examen aflegt:

- Prompt Engineering is het schrijven van een duidelijke, ondubbelzinnige examenvraag.

- Context Engineering is de student voorzien van de juiste studieboeken, notities en rekenmachine voordat het examen begint.

Vergelijking: Prompt vs. Context

| Kenmerk | Prompt Engineering | Context Engineering |

| Primaire focus | De formulering van de vraag. | De beschikbare data om de vraag te beantwoorden. |

| Scope | Enkele interactie (tactisch). | Volledige systeemarchitectuur (strategisch). |

| Hoofddoel | Een specifieke stijl/format uitlokken. | Feitelijke nauwkeurigheid en onderbouwing garanderen. |

| Schaalbaarheid | Laag (moeilijk handmatig te prompten voor elke uitzondering). | Hoog (geautomatiseerde data retrieval). |

| Vereiste skills | Linguïstiek, logica, iteratie. | Data engineering, vector search, API-integratie. |

Voor organisaties die hun teams willen bijscholen, is een Prompt Engineering-workshop uitstekend voor individuele productiviteit. Het bouwen van een bedrijfsbrede AI-oplossing vereist echter een AI-strategie die prioriteit geeft aan context engineering.

Waarom Context Engineering belangrijk is

Context engineering maakt het verschil tussen een leuke demo en een betrouwbare bedrijfstool.

1. Verminderen van hallucinaties

Hallucinaties treden vaak op wanneer een model gedwongen wordt te gokken omdat het informatie mist. Door de context zo te engineeren dat de exacte benodigde feiten worden opgenomen (bijv. “De huidige prijs van Product X is €50”), dwing je het model om zich aan de realiteit te houden. Dit is cruciaal voor sectoren met hoge compliance-eisen, waar een AI compliance-audit noodzakelijk kan zijn.

2. Kennisgrenzen overwinnen

LLM’s zijn bevroren in de tijd; ze weten alleen wat ze tijdens de training hebben geleerd (wat maanden geleden kan zijn geëindigd). Context engineering injecteert realtime data zoals aandelenkoersen, voorraadniveaus of het nieuws van vandaag, waardoor een “bevroren” model kan handelen op basis van actuele informatie.

3. Dataveiligheid en privacy

Context engineering fungeert als een firewall. In plaats van een medewerker gevoelige data in een openbaar model te laten plakken, maakt een veilige context-pipeline het mogelijk om data te anonimiseren of te filteren voordat deze het context window binnenkomt. Voor zeer gevoelige data combineren organisaties context engineering vaak met Lokale LLM-consultancy om de gehele contextverwerking on-premise te houden.

Implementeren van Context Engineering

Het bouwen van een systeem dat context intelligent beheert, omvat verschillende stappen:

- Vectorisatie: Je kennisbank (docs, wiki’s) omzetten in wiskundige vectoren.

- Opslag: Gebruikmaken van vectordatabases (zoals Pinecone, Weaviate of Milvus) om deze kennis op te slaan.

- Orkestratie: Workflows bouwen die de input van de gebruiker, de database en de LLM verbinden. Tools zoals n8n zijn hier krachtig; bekijk ons n8n Workflow Automation pakket om te zien hoe je deze pipelines automatiseert zonder zwaar codeerwerk.

- Optimalisatie: Continu testen welke stukken data (“chunks”) de beste antwoorden opleveren en de “chunk size” (hoeveel tekst wordt opgehaald) aanpassen.

Conclusie

Naarmate AI-modellen gemeengoed worden, zal het concurrentievoordeel niet liggen bij degenen die het beste model gebruiken, maar bij degenen die de beste context bieden. Context engineering is het mechanisme dat AI verankert in jouw unieke bedrijfsrealiteit en het transformeert van een generieke babbelbox in een nauwkeurige, betrouwbare asset voor de onderneming.

Voor leiders die verder willen kijken dan simpelweg prompten en robuuste, databewuste AI-systemen willen bouwen, is focussen op de engineering van context de noodzakelijke volgende stap.

Veelgestelde vragen (FAQ)

Wat is het verschil tussen RAG en context engineering?

RAG (Retrieval-Augmented Generation) is een specifieke techniek die wordt gebruikt binnen context engineering.Context engineering is de bredere discipline die RAG omvat, maar ook het beheer van systeem prompts, gespreksgeschiedenis en strategieën voor token-optimalisatie inhoudt.

Kan context engineering een slecht model repareren?

Tot op zekere hoogte. Een kleiner, minder capabel model (zoals Llama 3 8B) kan vaak beter presteren dan een enorm model (zoals GPT-4) als het kleinere model perfecte context krijgt en het grotere model geen enkele. Het model heeft echter nog steeds basis redeneervermogen nodig om de geboden context te begrijpen.

Vereist context engineering coderen?

Ja. Terwijl prompt engineering in een chat interface kan worden gedaan, vereist context engineering het bouwen van data pipelines, API-verbindingen en retrieval logica. Dit vereist doorgaans expertise in Machine Learning-ontwikkeling.

Is context engineering duur?

Dat kan. Meer tekst toevoegen aan het context window verhoogt het token gebruik, wat de kosten en latentie verhoogt.Effectieve context engineering draait om het vinden van de balans tussen genoeg informatie bieden voor accuratesse en de context beknopt houden om de kosten te beheersen.